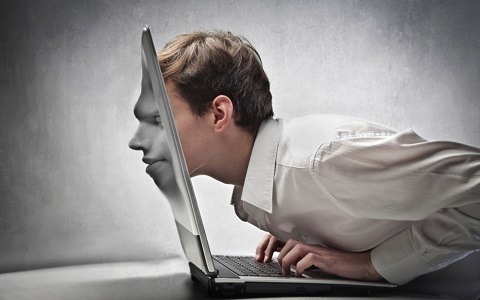

Как социальные сети вызывают «ожирение» мозга и продают нас корпорациям

Социальные медиа стали комфортной средой для жизни, но мы слишком мало знаем о законах работы цифровой среды. На днях хакеры украли данные 50 млн аккаунтов пользователей фейсбука, что нанесло компании куда больший урон, чем отдельно взятым пользователям: у Facebook украли большую партию товара, на котором он зарабатывает миллиарды долларов — информацию о нас с вами. Европа наконец поставила компании Facebook окончательный ультиматум: раскрыть пользователям механизмы работы соцсети, сбор данных и их продажу третьим сторонам — под угрозой блокировки. Как нас вычисляют по паттернам поведения в интернете, кому нужна информация о наших посещениях различных сайтов, зачем алгоритмы создают для каждого из нас информационный «пузырь», как это поляризует общество и причем здесь Филипп Киркоров — разбираемся в этом тексте.

«Если вы не читаете газет, то вы не информированы.

Если читаете газеты — то дезинформированы». — приписывается Марку Твену

Добряк Эрик Шмидт, глава совета директоров Google, с 2006 года трудится не покладая рук, чтобы мы не забивали себе голову вопросами вроде «в какой университет поступить?» — гугл скоро сможет посоветовать, куда податься и кем стать. Марк Цукерберг так прямо и говорит: главная задача его многомиллиардной корпорации — убедиться, что «у каждого человека есть чувство цели в жизни и общности с людьми».

Интернет-гиганты (прежде всего, Google и Facebook, которые на двоих контролируют больше половины рекламного интернет-рынка) беспрерывно собирают громадные массивы данных о своих пользователях, как будто лучший друг, который интересуется, чем ты занимаешься, всегда помогает и никогда не лезет с рассказами о себе. Собранную о нас информацию он превращает в полезные советы, сортирует для нас новости и фильмы и показывает нам только самое важное.

Почему эти ребята нас так любят и хотят причинить нам столько добра? Всё очень просто: наши технократические друзья торгуют нами.

Почему главный товар — мы и наше внимание

Сбор данных, их анализ и синтез в персонально подогнанные системы фильтров — очень ресурсоемкий процесс для компаний, которые этим занимаются. При этом его результатами юзеры чаще всего пользуются совершенно бесплатно. Всё потому, что платят за это компании-производители товаров и услуг (от одежды и еды до политики). Данные анализа наших действий и личности продают заинтересованным сторонам.

Гугл и фейсбук вешают на каждого пользователя сотни виртуальных бирок (вроде «любитель Фараона», «велосипедист», «безработный») — по ним рекламодатели различают среди безликой интернет-толпы свою потенциальную добычу. И чем стабильнее на нас держатся эти бирки, тем удобнее торговать нашим вниманием.

Схема продажи простая. Например, ты пришел в магазин Nike, нашел кроссовки, оплатил на кассе. Ты — покупатель, кроссовки — товар, а Nike — продавец. Но в случае с социальными медиа мы — это не покупатель, а кроссовки, аккуратно рассортированные и расставленные по полочкам.

Фейсбук и другие социальные медиа высасывают из своих пользователей самый ценный товар XXI века — внимание — и продают его компаниям, политикам и корпорациям, чтобы они эффективнее продавали нам свои товары и услуги. Сами социальные сети не производят контент, однако они точно знают, в каком информационном загончике сидит поклонник ягодиц, а где копошится любительница котиков и сплетен.

Канадский философ Маршалл Маклюэн еще в 1964 году, задолго до появления социальных медиа и поисковых гигантов, писал в своей книге «Понимание медиа»:

«Архимед как-то сказал: „Дайте мне точку опоры, и я переверну Землю“. Сегодня он ткнул бы пальцем в наши электрические средства коммуникации и сказал: „Я обопрусь на ваши глаза, уши, нервы и мозг, и мир будет вертеться в любом ритме и на любой манер, как только я пожелаю“. Эти „точки опоры“ мы и сдали в аренду частным корпорациям».

Мы предоставляем корпорациям свои глаза и уши для восприятия информации, которая в большой степени оказывается рекламой (или скрытой рекламой). Взамен мы получаем виртуальную версию мира, подогнанную под нас так, чтобы удерживать внимание как можно дольше. Поэтому в наших лентах собрано всё самое релевантное для нас: «Для тебя сейчас интереснее белочка, умирающая рядом с твоим домом, чем люди, умирающие в Африке», — говорит об этом Марк Цукерберг.

Как работает пузырь фильтров

Один из самых важных алгоритмов, на которых держится современный интернет — это система фильтров, помогающая пользователям отделить информационный шум от важной информации. Машины формируют теорию нашей личности из набора совершенных нами действий, на ее основе они выстраивают вокруг нас так называемый пузырь фильтров, определяющий, какой будет виртуальная реальность для каждого пользователя.

Чтобы понять, какая информация будет ценной для конкретного человека, алгоритмы собирают всю доступную о нем информацию: куда он ходит, чем интересуется, за что платит. Из этих данных формируется наш цифровой след, который мы оставляем за собой по всему интернету.

Цифровой след подобен отпечаткам пальцев, его уникальный для каждого пользователя рисунок определяет, какой контент ему будут показывать, какие сервисы ему будут доступны. Цифровой след — это ключ к отфильтрованной специально для конкретного пользователя версии интернета.

IT-гиганты используют данные нашего следа для того, чтобы удерживать наше внимание и увеличить время, проведенное в их сервисах и приложениях, где они бомбардируют нас таргетированной рекламой и любой другой нужной им информацией.

Часто люди выкладывают скриншот с поисковой строкой, в которой забиты слова «как сделать», а среди предложенных вариантов выплывают глупости вроде «как сделать так чтобы отпустило пожалуйста» или «как сделать так чтобы стоял пять часов». Забавно, на самом деле они смеются над самими собой и над своим цифровым отпечатком, а не над «глупостью» поисковика.

Что такое тоннель реальности

Отфильтрованный на основе нашего цифрового следа и истории интернет превращается в так называемый тоннель реальности, это понятие заимствовано из медицины. Тоннельное зрение — это болезнь, при которой человек теряет способность периферического обзора и видит только узкую область по центру сетчатки, в результате чего он начинает с трудом ориентироваться в пространстве.

Тоннель реальности — это тот узкий спектр явлений и мнений, которые мы видим, находясь внутри сформированной алгоритмами реальности. Мы перестаем воспринимать сложность и взаимосвязанность в мире и видим только то, что находится на цифровом «блюдце» перед нашим носом.

Наши прошлые клики определяют будущие клики — эта закономерность называется информационным детерминизмом, принципом жесткой обусловленности наших действий в интернете (в противовес идее о сети как о пространстве свободного волеизъявления). Из-за работы алгоритмов мы попадаем в бесконечную «я-петлю», каждым кликом воспроизводя и подтверждая уже созданную в информационном следе идентичность. Мы всё сильнее верим в то, во что и так верили, и чем больше разрастается наш цифровой след в социальных сетях и поисковиках, тем меньше вероятность, что в наш тоннель реальности попадет принципиально новая информация, способная расширить нашу картину мира и помочь нам измениться.

«У тебя одна идентичность! Те времена, когда у тебя был один имидж для приятелей на работе, другой — для твоих коллег, третий — для остальных твоих знакомых, наверное, уже подходят к концу… Иметь две личины — значит быть недостаточно честным». Марк Цукерберг

Информационный детерминизм тотален: наши прошлые выборы влияют на то, что мы видим сейчас; а то, что мы видим сейчас, влияет на наши будущие выборы. Если мы попадаем для поисковика в категорию тупых искателей эндорфинового кайфа, со временем мы действительно становимся еще тупее, так как нас окружают тупым контентом — это как плохая компания, только куда более влиятельная.

В более широком смысле всё наше общество в цифровой реальности формирует «мы-петли», разнося по сети мнения, которые из-за постоянного повторения становятся нормой сообщества, снова воспроизводятся и сильнее укрепляются — перенося свой эффект из цифровой в офлайновую реальность.

Как соцсети делают нас радикалами

Согласно теории разума, люди обладают способностью представлять, понимать и учитывать в своем поведении картину мира и чувства других людей. У нас есть представление о том, что происходит в головах у остальных. Однако в соцсетях эта способность дает сбой.

Так как пузыри фильтров для всех разные, часто мы не понимаем, какую картину мира видят наши знакомые, что их лента показывает конкретно им.

Пионеры интернета мечтали о том, что сеть поможет нам лучше понимать друг с друга, но нынешние исследователи однозначно сходятся на том, что мир стал более разобщенным, а у людей усилилось чувство изоляции.

Пользователи стали не только более разобщенными, но и более радикально настроенными против своих оппонентов. Всё больше людей считают себя«радикально консервативными» и «радикально либеральными».

Каких бы мнений вы ни придерживались, современная информационная среда приведет к их усугублению, к обострению деления мира на своих и чужих, так как алгоритмы показывают вам всё больше того, что соответствует вашим убеждениям и всё меньше того, что противоречит им.

Что такое культурный трайбализм

Подобно неумолкающему эху, соцсети способны бесконечно повторять и воспроизводить мнения — этот эффект называется эхо-камерой.

Этот эффект еще называют культурным трайбализмом, так как под действием алгоритмов пользователи разбиваются на интернет-племена со своими фетишами, табу и представлениями о вселенском зле. Они всё больше верят аргументам своих соплеменников, которые со временем становятся всё радикальнее и превращаются в догму.

Те, кто не вполне согласен с доминирующими в среде френдов мнениями, но не готов менять окружение, попадают в так называемую спираль молчания. Из-за страха изоляции они воздерживаются от высказывания собственного мнения, и со временем их сопротивление слабеет, что позволяет мнению большинства в интернет-стае стать общепринятой нормой.

Многообразие реакций и точек зрения в таких сообществах сводится к двум примитивным: либо облаять представителей чужой стаи, написать едкий и уничижительный комментарий, оскорбляющий противника; либо подлизываться к представителям своей стаи, стоящим на ступеньку выше, писать сахарные комментарии, поддакивать и множить бессмысленные комплименты. Соплеменника статусом пониже тоже могут обгавкать и самоутвердиться, намекнув, что младший по стае подозрительно похож на чужака и нуждается в прояснительной работе.

Как соцсети порождают национализм и мизогинию

Движение за права афроамериканцев #blacklivesmatter или движения против харассмента и сексуального насилия #metoo и #янебоюсьсказать получили широкий резонанс благодаря социальным сетям. Логично предположить, что они вызвали в обществе прилив толерантности, терпимости и взаимоуважения.

Как бы не так: парадоксальным образом они вызвали еще большую волну национализма и мизогинии.

Радикализация мнений во многом упирается в базисные алгоритмы, по которым работают социальные сети: они каталогизируют людей и кормят их контентом, который их сильнее всего цепляет.

Алгоритмы тщательно изучили активистов и сочувствующих движениям #metoo, #янебоюсьсказать и #blacklivesmatter: какой подбор слов их сильнее всего цепляет? что вызывает у них самый сильный протест? какие новости, истории и видео заставляют их проводить в социальных сетях максимальное количество времени? какие их особенности можно будет в дальнейшем использовать для более прицельного и действенного рекламного таргетирования?

Для максимального вовлечения пользователей нужно вызвать либо сильное одобрение и чувство, что контент делает их сильнее, умнее и краше — либо, наоборот, вызвать у них расстройство, раздражение, негодование. Эти реакции «прочитываются» алгоритмами в том числе по наборам ключевых слов.

Максимально выжав единомыслие из либерально мыслящей части пользователей, алгоритмы стали продвигать #янебоюсьсказать, #metoo и #blacklivesmatter пользователям, склонявшимся к патриархальным и националистическим ценностям — в качестве шок-контента.

Чтобы добиться максимального вовлечения, для их лент подбирались самые возмутительные, вызывающие и раздражающие их проявления этих движений. В результате даже нейтральные до этого момента пользователи начинали высказываться, ругаться и возмущаться — то есть стали проявлять дремавшие в них национализм и мизогинию.

Это, в свою очередь, помогло социальным сетям лучше идентифицировать их и повесить на них более выразительные бирки: «националисты» и «мизогины». И в их возбужденные ленты запускалось всё больше шовинистического контента, на который предполагался гарантированный отклик.

Когда очередная девушка делилась своим болезненным опытом с тегом #янебоюсьсказать, в комментариях появлялись ее знакомые и высказывали свое неодобрение: «зачем ты пишешь об этом здесь?», «ты преувеличиваешь!». Люди ссорились, удаляли друг друга из друзей, писали новые гневные посты — и всё это помогало алгоритмам четче их каталогизировать.

В результате их тоннели цифровой реальности расходились в совершенно разные стороны: одних бомбардировали новостями о таксистах-насильниках и злоключениях ЛГБТ-сообщества на постсоветском пространстве, а другим рассказывали о пользе сохи с лопатой и мощи межконтинентальных ракет с неограниченным временем полета.

Виртуальность как критерий истинности

В эпоху тотального кликбейта виральность стала основным критерием истинности. Чем больше людей верят во что-то, тем реальнее это что-то становится и начинает менять мир вокруг. Fake news, мемы и комментарии ботов представляют собой яркие мнения, а чем ярче мнение, тем сильнее оно приковывает внимание и тем больше людей за ним следует.

Никто не может самостоятельно провести исследования на тему того, вызывают ли прививки аутизм, или они всё же благо, спасающее миллионы жизней. Но если новостная лента — основной источник нашей информированности, то как мы можем быть уверенными в правдивости одного сообщения и в ложности другого? Алгоритм не пропустит внутрь информационного тоннеля антипрививочника аргументы против его мнения, зато увеличит вероятность попадания в него идей ВИЧ-диссидентов или верующих в масонский заговор и мировую доминацию рептилоидов.

Проблема не в том, что такие мнения существуют или что люди в них верят, а в том, что социальные сети усугубляют уверенность в собственной правоте и минимизируют шансы узнать противоположные точки зрения.

Пионер виртуальной реальности Джарон Ланье называет технологии фильтрации и подгону пользователям нужного трафика — BUMMER-машинами (на русский можно перевести как «машины по производству полной херни»). Он дает им 6 характеристик:

Они захватывают внимание, что ведет к верховенству мудаков.

Они суют свой нос в жизни всех людей.

Они запихивают контент людям в глотки.

Они управляют поведением людей самыми подлыми способами.

Они зарабатывают деньги, позволяя худшим мудакам тайком разводить всех остальных.

Они создают фальшивые толпы и жульническое общество.

Что такое информационный джанк-фуд

В ходе эволюционного развития наши тела выработали тягу к жирной и богатой углеводами пище, потому что она редко встречалась в природе и была необходима для выживания. Даже сейчас, когда наша цивилизация производит еду в избытке, мы инстинктивно тянемся к мороженому и бургеру, хотя знаем, что избыток калорий разрушительно воздействует на наше здоровье. Поэтому обеспеченная часть человечества озабочена диетами и правильным питанием.

Однако такие же эволюционные механизмы верны и для нашего мозга: мы автоматически обращаем внимание на всё, что связанно с сексом, насилием, социальным одобрением и другими явлениями, важными для выживания.

Создатели социальных сетей отлично понимают, как работает наш мозг, а так как основной ресурс, который они пытаются получить от пользователей — это внимание, то они обильно снабжают наш тоннель цифровой реальности вредными «жирами и углеводами» для мозга: сплетнями, срачами, эротикой, страшными и смешными историями.

Медиа беспрерывно генерируют гамбургеры из новостей про лекарства от рака, картошку фри из «10 секретов успеха и быстрого похудения», пиццу из тестов «на какую знаменитость вы похожи» и бесчисленное множество другого информационного джанк-фуда. Бесконечная лента новостей и видео на автоплее — это цифровой аналог самовосполняющейся тарелки супа из эксперимента корнеллского профессора Брайана Вансинка. Он доказал, что люди, евшие суп из тарелки, в которую постоянно доливался суп, в результате съели на 73 % больше калорий, чем люди, евшие из обычной тарелки, — да еще и недооценили свою порцию на 140 калорий.

Мы бездумно потребляем контент, наименее полезный для личного и общественного развития, и незаметно приобретаем психологический аналог ожирения. Наши неповоротливые интеллектуальные тела перестают отличать реальность от выдумки и верят в особый смысл третьего сентября или великую социальную значимость Фейса с Монеточкой.

Какой именно информационный джанк поставляется в наши ленты, зависит от той модели нашей личности, которую запечатлел наш цифровой след. Благодаря точной статистике по потреблению информации производители контента постоянно подстраиваются под потребителя и уже не столько диктуют информационную повестку, сколько следуют за желаниями публики и их аддиктивности к «жирной» и чересчур «сладкой» информации. Netflix решает, какие сериалы снимать и что делать с героями историй, опираясь на сверхточные данные о реакции зрителей, и старается апеллировать к общему знаменателю для всех людей: крови, сексу, предательству, изменам и т. д.

Раньше эту функцию выполняли продюсеры вроде Харви Вайнштейна, они руководствовались холодным расчетом, но иногда позволяли своим подопечным сделать творческое высказывание.

Алгоритмы только считают: они не знают, что такое творчество в отрыве от нервной реакции зрителя. Поэтому неудивительно, что самые популярные фильмы и сериалы нашего времени — набор воздействующих на спинной мозг эффектов (больше насилия, больше секса, больше нарушения табу) и клишированных диалогов.

То же самое происходит и в музыкальной индустрии, особенно в отношении видеоклипов: YouTube точно знает, что сработает и как, поэтому Филлип Киркоров может получить вторую, третью или какую там по счету жизнь — достаточно опереться на статистику и наполнить видео стабильно работающими клише и мемами, чтобы приученный к джанк-фуду зритель дал нужный отклик и принял старичка постсоветского шоу-бизнеса за в доску своего парня.

И что?

Бизнес-модели, позволяющие IT-корпорациям зарабатывать триллионы долларов на наших природных слабостях, вряд ли исчезнут в ближайшее время. При этом нельзя сказать, что эти технологии делают что-то принципиально новое: медиа всегда работало на пропаганду, гналось за скандалами и интригами, эксплуатировало секс и насилие, а основные деньги получало от рекламы и лоббирования политических интересов. Поменялась разве что интенсивность, с которой всё это происходит. А также пока что доминирует романтическое мироощущение, с которым люди всё это потребляют: у пользователей появилась устойчивая иллюзия свободы выбора и большей осведомленности.

Поляризация, к которой приводят социальные медиа, — не злой умысел ее создателей. Большинство топовых работников технологических гигантов, по иронии, — либералы и демократы, однако именно их детища способствуют неконтролируемому росту национализма и ксенофобии.

Предвзятость настоящего — так называется склонность людей выбирать ближайшую выгоду вместо долгосрочной. Между нашим текущим «я» и будущим «я» существует разрыв. И хотя всем нам хотелось бы в будущем стать лучше, мы упорно совершаем выборы, которые соответствуют выгоде текущего момента, сиюминутным желаниям, а не предпочтительному будущему. Пузыри фильтров в социальных медиа потакают именно этой нашей особенности.

Если мы сможем узнать, как нас видят алгоритмы, и задать им желаемую траекторию собственного развития, тогда сила машин поможет нам выстроить свой тоннель реальности осознанно. Передвижение по нему было бы развивающим и захватывающим, а на другом его конце нас встретила бы лучшая и обновленная версия нас самих, а не мастурбирующий любитель котиков и срача в комментариях.

Но для этого человечество должно осознать ценность информации и заставить корпорации сделать свои дата-базы прозрачными и подконтрольными самим пользователям. Звучит как фантастика.

24.02.2019, 10:55

Присоединяйтесь в Вконтакте